Google ने TurboQuant प्रकाशित किया है, एक compression algorithm जो पूरी artificial intelligence industry के खेल के नियम बदल सकता है। Google Research के Amir Zandieh और Vahab Mirrokni के नेतृत्व में यह शोध कार्य 24 मार्च को प्रतिष्ठित ICLR 2026 सम्मेलन में प्रस्तुत किया गया, और वर्तमान language models की सबसे बड़ी तकनीकी समस्या पर सीधा प्रहार करता है: उनकी अत्यधिक memory खपत। और परिणाम प्रभावशाली हैं।

AI इतनी memory क्यों खाती है

TurboQuant के महत्व को समझने के लिए पहले यह समझना जरूरी है कि आज AI को क्या धीमा कर रहा है। जब GPT, Gemini या Claude जैसा model text generate करता है, तो वह हर शब्द के साथ शून्य से शुरू नहीं करता। यह प्रत्येक पहले से generated शब्द के लिए key-value (या KV cache) नामक गणितीय vectors को memory में store करता है। व्यावहारिक रूप से, आपकी conversation का प्रत्येक शब्द 16-bit precision में store की गई decimal संख्याओं की एक श्रृंखला (जैसे 1.29, 0.03, -0.76, 0.91...) में बदल जाता है।

समस्या क्या है? यह cache text की लंबाई के साथ linearly बढ़ता है। 32,000 tokens के context वाले 8 billion parameter model के लिए, अकेला KV cache लगभग 4.6 GB VRAM खाता है। अक्सर, model नहीं बल्कि cache GPU memory को saturate करता है। यही bottleneck है जिसे TurboQuant हल करने आया है।

TurboQuant कैसे काम करता है

Algorithm दो elegant mathematical steps में काम करता है, जिनमें से प्रत्येक ठोस theoretical आधार पर आधारित है।

Step 1: PolarQuant — data का पुनर्गठन

पहले step में data vectors पर random rotation लागू करना शामिल है। Classic Cartesian coordinates को polar coordinates (radius + angle) में convert करके, PolarQuant प्रत्येक vector की energy को उसके सभी components में समान रूप से वितरित करता है। परिणाम? एक predictable statistical distribution जो Lloyd-Max algorithm के माध्यम से optimal quantization की अनुमति देती है, target model पर कुछ भी calibrate करने की जरूरत के बिना। यह step costly normalization constants को memory में store करने की आवश्यकता को भी समाप्त करता है।

Step 2: QJL — residual errors को सुधारना

दूसरा step पहले compression द्वारा छोड़ी गई residual error को संभालता है। Quantized Johnson-Lindenstrauss (QJL) algorithm इस error को mathematical transformation के माध्यम से project करता है, फिर प्रति element केवल एक bit रखता है: sign (+1 या -1)। यह correction attention scores के estimation को mathematically unbiased बनाता है, जिसमें memory overhead लगभग शून्य है।

खुद बोलते हैं नंबर

Google Research द्वारा announced performance numbers उल्लेखनीय हैं:

- KV cache memory में 6x कमी बिना measurable precision loss के

- किसी भी retraining के बिना caches को 3 bits per element तक compress करना (सामान्यतः 16 bits)

- 32-bit unquantized keys की तुलना में NVIDIA H100 GPU पर 8x तक speed gain

- LongBench, Needle In A Haystack, ZeroSCROLLS, RULER और L-Eval benchmarks पर original precision के virtually समान performance

Tests Gemma और Mistral models पर किए गए, जिसमें विविध tasks शामिल थे: question answering, code generation और text summarization।

तीन फायदे जो खेल बदल देते हैं

Training की जरूरत नहीं। अन्य compression methods के विपरीत, TurboQuant को किसी fine-tuning या calibration dataset की आवश्यकता नहीं है। इसे किसी भी existing Transformer model पर सीधे apply किया जा सकता है।

Model-agnostic। Algorithm किसी भी Transformer architecture पर काम करता है। Gemini, Llama, Mistral या किसी अन्य model के उपयोग के अनुसार इसे adapt करने की जरूरत नहीं।

Data-agnostic। TurboQuant "data-oblivious" है: processed data के distribution की परवाह किए बिना इसकी theoretical guarantees बनी रहती हैं। इसे काम करवाने के लिए किसी specific dataset की जरूरत नहीं।

Developers के लिए concrete impact

व्यवहार में, TurboQuant consumer-grade hardware पर काफी बड़े models चलाना संभव बनाता है। 4-bit quantized weights को 4-bit compressed KV cache के साथ combine करके, पहले अकल्पनीय configurations एक साधारण gaming graphics card पर viable हो जाती हैं।

Open source community ने इंतजार नहीं किया: HuggingFace, llama.cpp, vLLM compatible versions और एक standalone Rust library सहित कई implementations पहले से उपलब्ध हैं। Code कुछ lines में use होता है:

Sweet spot 4 bits पर है, जहां 3 billion parameters और उससे अधिक के models पर quality FP16 से अलग नहीं होती। 3 bits पर, small models (1.6 billion parameters से कम) पर slight degradation दिख सकती है।

AI industry के लिए consequences

संभावित impact developer world से कहीं आगे जाता है। यदि TurboQuant सामान्य हो जाता है — और सभी संकेत ऐसा ही बताते हैं — AI model inference costs 50% या उससे अधिक कम हो सकती हैं। Google Cloud, AWS या Azure जैसी cloud services एक ही hardware से अधिक requests serve कर सकेंगी। Billion-scale vector databases पर semantic search काफी अधिक efficient हो जाएगी।

आश्चर्य की बात नहीं, इस announcement ने financial markets में पहले से reactions उत्पन्न किए हैं: high-performance memory की demand में कमी की उम्मीद से memory chip manufacturers के stocks गिरे। कुछ analysts इसके impact की तुलना 2025 की शुरुआत में DeepSeek से करते हैं।

TurboQuant उस तरह की technical advance है जो mainstream headlines नहीं बनाती, लेकिन पूरी एक industry को चुपचाप transform करती है। Quality loss के बिना, retraining के बिना AI की working memory को 6 से 8 गुना compress करके, Google ने potentially artificial intelligence को बहुत अधिक accessible — और deploy करने में बहुत कम costly बना दिया है।

Hindi

Hindi  French

French  English

English  Spanish

Spanish  Chinese

Chinese  Japanese

Japanese  Korean

Korean  German

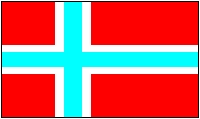

German  Norwegian

Norwegian