구글이 TurboQuant를 발표했습니다. 이는 인공지능 업계 전체의 판도를 바꿀 수 있는 압축 알고리즘입니다. 구글 리서치의 Amir Zandieh와 Vahab Mirrokni가 이끄는 이 연구 성과는 3월 24일 권위 있는 ICLR 2026 컨퍼런스에서 발표되었으며, 현재 언어 모델의 가장 큰 기술적 문제 중 하나인 엄청난 메모리 소비를 정면으로 다룹니다. 결과는 인상적입니다.

AI가 왜 이렇게 많은 메모리를 소비하는가

TurboQuant의 중요성을 이해하려면 먼저 오늘날 AI의 속도를 늦추는 것이 무엇인지 파악해야 합니다. GPT, Gemini, Claude 같은 모델이 텍스트를 생성할 때, 매번 처음부터 시작하지 않습니다. 이미 생성된 각 단어에 대해 키-값(KV 캐시)이라는 수학적 벡터를 메모리에 저장합니다. 구체적으로, 대화의 각 단어는 16비트 정밀도로 저장되는 일련의 소수(예: 1.29, 0.03, -0.76, 0.91...)로 변환됩니다.

문제는 무엇일까요? 이 캐시는 텍스트 길이에 따라 선형으로 증가합니다. 32,000 토큰의 컨텍스트를 가진 80억 파라미터 모델의 경우, KV 캐시만으로도 약 4.6GB의 VRAM을 소비합니다. 종종 모델 자체가 아닌 캐시가 GPU 메모리를 포화시킵니다. 바로 이 병목 현상을 TurboQuant가 해결합니다.

TurboQuant의 작동 원리

이 알고리즘은 견고한 이론적 기반 위에 세워진 두 가지 우아한 수학적 단계로 작동합니다.

1단계: PolarQuant — 데이터 재구성

첫 번째 단계는 데이터 벡터에 무작위 회전을 적용하는 것입니다. 고전적인 직교 좌표를 극좌표(반지름 + 각도)로 변환함으로써, PolarQuant는 각 벡터의 에너지를 모든 구성 요소에 균등하게 분배합니다. 결과는? Lloyd-Max 알고리즘을 통한 최적 양자화를 가능하게 하는 예측 가능한 통계 분포가 생성되며, 대상 모델에서 아무것도 보정할 필요가 없습니다. 이 단계는 또한 비용이 많이 드는 정규화 상수를 메모리에 저장할 필요성을 없앱니다.

2단계: QJL — 잔여 오류 수정

두 번째 단계는 첫 번째 압축에서 남은 잔여 오류를 처리합니다. 양자화 Johnson-Lindenstrauss(QJL) 알고리즘은 이 오류를 수학적 변환을 통해 투영한 후 요소당 단 1비트인 부호(+1 또는 -1)만 유지합니다. 이 보정은 어텐션 점수 추정을 수학적으로 불편(unbiased)하게 만들며, 메모리 오버헤드는 거의 없습니다.

숫자로 보는 성과

구글 리서치가 발표한 성능 수치는 주목할 만합니다:

- 측정 가능한 정밀도 손실 없이 KV 캐시 메모리 6배 감소

- 재훈련 없이 캐시를 요소당 3비트로 압축(일반적으로 16비트)

- 32비트 비양자화 키 대비 NVIDIA H100 GPU에서 최대 8배 속도 향상

- LongBench, Needle In A Haystack, ZeroSCROLLS, RULER, L-Eval 벤치마크에서 원본 정밀도와 거의 동일한 성능

테스트는 Gemma와 Mistral 모델에서 진행되었으며, 질문 답변, 코드 생성, 텍스트 요약 등 다양한 작업을 포함합니다.

게임을 바꾸는 세 가지 장점

훈련 불필요. 다른 압축 방법과 달리 TurboQuant는 파인튜닝이나 보정 데이터셋이 필요 없습니다. 기존의 모든 Transformer 모델에 그대로 직접 적용할 수 있습니다.

모델 무관. 이 알고리즘은 모든 Transformer 아키텍처에서 작동합니다. Gemini, Llama, Mistral 또는 다른 모델을 사용하더라도 적응이 필요 없습니다.

데이터 무관. TurboQuant는 소위 "데이터 비인식"입니다: 처리되는 데이터의 분포에 관계없이 이론적 보장이 성립합니다. 작동을 위한 특정 데이터셋이 필요하지 않습니다.

개발자를 위한 실질적 영향

실제로 TurboQuant는 소비자용 하드웨어에서 훨씬 더 큰 모델을 실행할 수 있게 합니다. 4비트 양자화 가중치와 4비트 압축 KV 캐시를 결합함으로써, 이전에는 생각할 수 없었던 구성이 일반 게이밍 그래픽 카드에서 실현 가능해집니다.

오픈소스 커뮤니티는 기다리지 않았습니다: HuggingFace, llama.cpp, vLLM 호환 버전과 독립형 Rust 라이브러리를 포함한 여러 구현이 이미 사용 가능합니다. 코드는 몇 줄로 사용할 수 있습니다:

스위트 스팟은 4비트로, 30억 파라미터 이상의 모델에서는 품질이 FP16과 구별이 안 됩니다. 3비트에서는 소형 모델(16억 파라미터 미만)에서 약간의 품질 저하가 나타날 수 있습니다.

AI 산업에 미치는 영향

잠재적 영향은 개발자 세계를 훨씬 넘어섭니다. TurboQuant가 일반화된다면(모든 징후가 그렇게 될 것임을 시사합니다), AI 모델 추론 비용이 50% 이상 감소할 수 있습니다. Google Cloud, AWS, Azure 같은 클라우드 서비스는 동일한 하드웨어로 더 많은 요청을 처리할 수 있게 됩니다. 수십억 규모의 벡터 데이터베이스에서의 시맨틱 검색이 훨씬 효율적이 됩니다.

당연히 이 발표는 금융 시장에서 이미 반응을 불러일으켰습니다: 고성능 메모리 수요 감소를 예상하는 투자자들로 인해 메모리 칩 제조업체의 주가가 하락했습니다. 일부 분석가들은 그 영향을 2025년 초 DeepSeek과 비교하기도 합니다.

TurboQuant는 일반 대중 미디어의 헤드라인을 장식하지 않지만, 조용히 산업 전체를 변환시키는 유형의 기술 발전입니다. 품질 손실 없이, 재훈련 없이 AI의 작업 메모리를 6~8배 압축함으로써, 구글은 인공지능을 훨씬 더 접근 가능하고 훨씬 더 저렴하게 배포할 수 있게 만들었을 가능성이 있습니다.

Korean

Korean  French

French  English

English  Spanish

Spanish  Chinese

Chinese  Japanese

Japanese  Hindi

Hindi  German

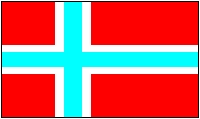

German  Norwegian

Norwegian