GoogleがTurboQuantを発表しました。これは人工知能業界全体のゲームルールを変える可能性がある圧縮アルゴリズムです。Google ResearchのAmir ZandiehとVahab Mirrokniによるこの研究成果は、3月24日に権威あるICLR 2026カンファレンスで発表され、現在の言語モデルが抱える最大の技術的問題のひとつであるメモリ消費の問題に真正面から取り組んでいます。そして結果は印象的です。

なぜAIはこれほどメモリを消費するのか

TurboQuantの重要性を理解するためには、まず今日のAIを遅くしている原因を把握する必要があります。GPT、Gemini、ClaudeのようなモデルがテキストをGenesisするとき、毎回ゼロから始めるわけではありません。既に生成された各単語についてキー・バリュー(KVキャッシュ)と呼ばれる数学的ベクトルをメモリに保存します。具体的には、会話の各単語が一連の小数(例えば1.29、0.03、-0.76、0.91...)に変換され、16ビット精度で保存されます。

問題は何か?このキャッシュはテキストの長さに応じて線形に増大します。32,000トークンのコンテキストを持つ80億パラメータのモデルでは、KVキャッシュだけで約4.6GBのVRAMを消費します。多くの場合、モデル自体ではなくキャッシュがGPUメモリを圧迫します。このボトルネックこそがTurboQuantが解決しようとしているものです。

TurboQuantの仕組み

このアルゴリズムは、それぞれ確固たる理論的基盤に基づく2つのエレガントな数学的ステップで動作します。

ステップ1:PolarQuant — データの再編成

最初のステップは、データベクトルにランダム回転を適用することです。古典的な直交座標を極座標(半径+角度)に変換することで、PolarQuantは各ベクトルのエネルギーをすべてのコンポーネントに均等に分配します。結果は?Lloyd-Maxアルゴリズムによる最適量子化を可能にする予測可能な統計的分布が得られ、ターゲットモデルで何もキャリブレーションする必要がありません。このステップはまた、コストのかかる正規化定数をメモリに保存する必要性を排除します。

ステップ2:QJL — 残差誤差の修正

2番目のステップは、最初の圧縮によって残された残差誤差を処理します。量子化Johnson-Lindenstrauss(QJL)アルゴリズムはこの誤差を数学的変換に通して射影し、要素ごとにたった1ビット(符号:+1または-1)だけを保持します。この補正により、アテンションスコアの推定は数学的に不偏になり、メモリオーバーヘッドはほぼゼロです。

数字が物語る成果

Google Researchが発表したパフォーマンス数値は注目に値します:

- 測定可能な精度損失なしでKVキャッシュメモリを6倍削減

- 再トレーニングなしで、キャッシュを要素あたり3ビットに圧縮(通常16ビット)

- 32ビット非量子化キーと比較して、NVIDIA H100 GPUで最大8倍の速度向上

- LongBench、Needle In A Haystack、ZeroSCROLLS、RULER、L-Evalベンチマークで元の精度と実質的に同一のパフォーマンス

テストはGemmaとMistralモデルで行われ、質問応答、コード生成、テキスト要約など多様なタスクをカバーしています。

ゲームを変える3つの優位点

トレーニング不要。他の圧縮手法と異なり、TurboQuantはファインチューニングもキャリブレーションデータセットも必要ありません。既存のTransformerモデルにそのまま直接適用できます。

モデル非依存。このアルゴリズムはあらゆるTransformerアーキテクチャで機能します。Gemini、Llama、Mistral、その他のモデルのどれを使うかに関わらず適応の必要はありません。

データ非依存。TurboQuantはいわゆる「データ非認識」です:処理されるデータの分布に関わらず理論的保証が成立します。動作させるために特定のデータセットは不要です。

開発者への具体的な影響

実際には、TurboQuantによってコンシューマー向けハードウェアで格段に大きなモデルを動かすことが可能になります。4ビット量子化重みと4ビット圧縮KVキャッシュを組み合わせることで、以前は考えられなかった構成が一般的なゲーミングGPUで実現可能になります。

オープンソースコミュニティはすでに動き出しています:HuggingFace、llama.cpp、vLLM対応バージョンや、スタンドアロンのRustライブラリを含む複数の実装が既に利用可能です。コードは数行で使用できます:

スイートスポットは4ビットで、30億パラメータ以上のモデルでは品質がFP16と区別できません。3ビットでは小型モデル(16億パラメータ未満)でわずかな劣化が現れる場合があります。

AI業界への影響

潜在的な影響は開発者の世界をはるかに超えています。TurboQuantが普及すれば(そしてすべての兆候がそうなることを示唆しています)、AIモデルの推論コストは50%以上削減される可能性があります。Google Cloud、AWS、Azureなどのクラウドサービスは同じハードウェアでより多くのリクエストを処理できるようになります。数十億規模のベクターデータベースでのセマンティック検索がはるかに効率的になります。

当然ながら、この発表は金融市場にすでに反応を引き起こしています:メモリチップメーカーの株価が下落し、投資家たちが高性能メモリの需要減少を見込んでいます。一部のアナリストは、その影響を2025年初頭のDeepSeekに例えています。

TurboQuantは一般メディアの大見出しにはならない種類の技術的進歩ですが、産業全体を静かに変革するタイプのものです。品質損失なし、再トレーニングなしでAIの作業メモリを6〜8倍圧縮することで、Googleは人工知能をはるかにアクセスしやすく、かつデプロイコストを大幅に削減できる存在にした可能性があります。

Japanese

Japanese  French

French  English

English  Spanish

Spanish  Chinese

Chinese  Korean

Korean  Hindi

Hindi  German

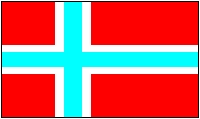

German  Norwegian

Norwegian